Qu’est-ce que la latence vidéo ? Le guide définitif pour les radiodiffuseurs

La latence vidéo est un aspect majeur de la diffusion en direct sur l’internet. Il s’agit d’une mesure technique qui affecte l’expérience de visionnage de votre flux.

Plusieurs éléments techniques contribuent à la latence vidéo. La latence de votre flux dépendra donc de la puissance de votre configuration de streaming.

Dans ce billet, nous allons répondre à toutes vos questions sur la latence vidéo. Nous commencerons par examiner ce qu’est la latence vidéo dans le contexte de la diffusion en direct avant de nous pencher sur des aspects plus techniques. Nous déterminerons ce qui affecte la latence vidéo et comment contrôler la latence de vos flux.

Table des matières

- Qu’est-ce que la latence vidéo ?

- Pourquoi le temps de latence est-il important ?

- Qu’est-ce qui affecte la latence vidéo ?

- Qu’est-ce qu’une latence vidéo moyenne ?

- Comment calculer la latence vidéo

- Comment réduire la latence lors de la diffusion en continu

- Comment réduire la latence au niveau de l’encodeur ?

- Paramètres de diffusion en continu

- Latence vidéo sur Dacast

- Réflexions finales

Qu’est-ce que la latence vidéo ?

La latence vidéo est la mesure du temps nécessaire à un signal vidéo pour voyager de la source qui capture la vidéo jusqu’au lecteur vidéo. La latence dépend de plusieurs facteurs techniques, et varie donc en fonction de la configuration du site web de streaming. configuration de streaming de site web que vous avez.

À ne pas confondre avec le “retard”, qui est le laps de temps intentionnel entre l’enregistrement et la diffusion d’une vidéo. Cela permet de synchroniser les sources de diffusion en continu et de donner aux producteurs le temps de mettre en œuvre les éléments cinématographiques.

La latence vidéo est moins intentionnelle et plus un sous-produit de la configuration technique du flux. La seule chose que vous puissiez faire est d’essayer de la réduire autant que possible tout en maintenant la qualité du flux pour offrir à vos téléspectateurs une expérience de visualisation en temps réel.

Pourquoi le temps de latence est-il important ?

La latence est très importante pour les radiodiffuseurs car, dans de nombreux cas, elle affecte l’expérience de l’utilisateur. C’est notamment le cas pour événements en direct qui gagnent à être réalistes.

Imaginons que vous diffusiez une cérémonie de remise de diplômes. Le moment où chaque élève franchit la scène marque une étape importante pour lui et sa famille. Les proches qui regardent le flux depuis leur domicile pensent qu’ils vivent ce moment spécial en temps réel, ou du moins qu’ils s’en approchent. Si votre public sait que votre flux est en retard, la connexion semble moins réelle.

De nombreux professionnels de la diffusion en continu affirment qu’une latence élevée est préjudiciable au résultat d’un flux, car plus la latence est importante, moins le flux est réaliste.

La latence est également un facteur important pour la vidéoconférence. Des plateformes telles que Zoom et Google Meets prennent en charge la latence en temps réel, ce qui permet aux gens d’avoir des conversations numériques qui imitent les interactions en face à face. Sans latence en temps réel, le chat vidéo ne serait pas possible.

Mais si vous diffusez un événement pour lequel vous voulez que les téléspectateurs voient ce qui se passe en temps réel, vous devez essayer de réduire la latence autant que possible.

Qu’est-ce qui affecte la latence vidéo ?

Différents éléments d’une installation de diffusion en direct contribuent à la latence. Tout, depuis votre réseau internet jusqu’à votre hébergeur de vidéo en direct, provoque des temps de latence.

Cela dit, passons en revue les éléments qui contribuent à la latence vidéo.

Connexion Internet

Un internet rapide et fiable est indispensable pour la diffusion en direct. Lorsque votre connexion internet n’est pas à la hauteur, la latence de votre vidéo augmente. La vitesse, ou le débit, de votre réseau Internet aura une incidence directe sur la latence de votre flux.

La vitesse internet suggérée est le double de la bande passante que vous avez l’intention d’utiliser pour votre flux vidéo. Les vidéos à haute résolution nécessitent donc une connexion internet plus rapide afin de maintenir une latence faible.

Vous pouvez tester votre vitesse internet en recherchant “test de vitesse internet” sur Google et en cliquant sur “Exécuter un test de vitesse” dans le premier résultat.

Nous recommandons d’utiliser une connexion Ethernet pour obtenir l’internet le plus rapide et le plus fiable. Le WiFi et les données cellulaires peuvent être utilisés comme options de secours, mais l’Ethernet est le choix préféré. Quelle que soit l’option choisie, vous devez effectuer un test de vitesse avant la diffusion pour vous assurer que tout va bien.

L’une des raisons en est que les câbles Ethernet ont une latence beaucoup plus faible que le WiFi. Cette réduction de la latence peut avoir un impact important sur la latence globale de votre vidéo.

Réglages du codeur

Avec la diffusion en ligne, une vidéo doit être encodée, transportée et décodée. C’est là qu’une grande partie de la latence est causée, il est donc important que les paramètres de votre encodeur soient correctement réglés et configurés pour rationaliser ce processus.

Bien qu’il n’existe pas de combinaison magique de paramètres d’encodage permettant d’obtenir une diffusion en continu à faible latence, il est important de vérifier auprès de l’hébergeur de vidéo en continu que vous avez choisi les paramètres qu’il exige ou recommande.

Dacast, par exemple, exige que les diffuseurs utilisent un codec H.264 ou x264, une fréquence d’images de 25 ou 30, un intervalle de 2 secondes entre les images et un balayage progressif. Pour avoir une meilleure idée des paramètres optimaux de l’encodeur afin de réduire la latence de votre vidéo, nous vous recommandons de consulter notre guide complet pour configurations des réglages de l’encodeur .

Protocoles vidéo

Les protocoles vidéo jouent un rôle majeur dans la latence. Les différents protocoles de diffusion en continu sont capables de diffuser en continu avec des temps de latence différents.

Actuellement, le protocole optimal pour la diffusion en continu à faible latence est le suivant HTTPS Live Streaming (HLS) pour la diffusion et le le protocole de messagerie en temps réel (RTMP) pour l’ingestion. HLS est le protocole le plus répandu pour la diffusion en continu, car il est compatible avec le lecteur vidéo HTML5. Toutefois, le L’aspect RTMP ingest réduit considérablement la latence.

La diffusion HLS avec ingestion HLS est possible, mais elle ne prend pas en charge la diffusion en continu à faible latence comme le fait la combinaison diffusion HLS/ingestion RTMP.

Transport fiable et sécurisé (SRT) est un protocole de streaming vidéo innovant développé par Haivision. Ce protocole est connu pour sa diffusion en continu sécurisée et à faible latence. Malheureusement, la SRT est relativement récente, de sorte que la plupart des plateformes modernes de diffusion en direct et les technologies connexes ne sont pas encore adaptées à la diffusion SRT. Toutefois, une fois que ce protocole sera plus largement pris en charge, il réduira la latence vidéo de manière générale.

Une autre technologie plus récente créée pour réduire la latence vidéo est la technologie WebRTC . WebRTC est un projet de diffusion en continu à code source ouvert qui a été conçu pour permettre la diffusion en continu avec une latence en temps réel. Il a été spécialement conçu pour les vidéoconférences. Ce projet est actuellement utilisé par les principales plates-formes de vidéoconférence, mais il pourrait également aider les plates-formes de diffusion vidéo en direct à réduire leur temps de latence.

Qu’est-ce qu’une latence vidéo moyenne ?

La latence moyenne pour un flux vidéo en ligne est de six secondes ce qui est considéré comme une faible latence.

Cela dit, voici une ventilation de quelques catégories courantes de latence.

| Type de latence | Temps de latence |

| Latence de la radiodiffusion standard | 5-18 secondes |

| Faible latence | 1-5 secondes |

| Très faible latence | Moins d’une seconde |

| Temps de latence en temps réel | Incompréhensible pour les utilisateurs |

La télévision traditionnelle et certains flux OTT entrent dans la catégorie de latence de la radiodiffusion standard. La télévision traditionnelle est souvent plus proche de 18 secondes, et le streaming OTT. Certains flux OTT entrent dans la catégorie des flux à faible latence.

La latence en temps réel est utilisée pour les vidéoconférences sur les plateformes de communication, telles que Zoom, Facetime, Google Meets et d’autres outils de chat vidéo.

Comment mesurer la latence vidéo

La latence ayant une incidence sur l’expérience des téléspectateurs, il est important de savoir ce que votre installation de diffusion en continu est capable de faire.

Mesurer votre temps de latence peut s’avérer un peu difficile. La façon la plus précise de mesurer la latence d’une vidéo est d’ajouter un horodatage à votre vidéo et de demander à quelqu’un de regarder le flux en direct. Demandez-leur de signaler l’heure exacte à laquelle l’image horodatée apparaît sur leur écran. Soustrayez l’heure de l’horodatage de l’heure à laquelle le spectateur a vu l’image, et vous obtiendrez votre temps de latence.

Si vous ne savez pas comment horodater votre flux, vous pouvez également demander à quelqu’un de regarder votre flux et lui dire d’enregistrer lorsqu’un signal spécifique est diffusé. Le temps de latence est obtenu en soustrayant le temps d’exécution du repère du temps de visualisation du repère.

La seconde méthode est moins précise car elle laisse plus de place à l’erreur, mais elle vous donnera une idée assez précise de la latence de votre installation.

Comment réduire la latence lors de la diffusion en continu

Les radiodiffuseurs peuvent réduire la latence de différentes manières. La latence étant déterminée par plusieurs éléments, les radiodiffuseurs doivent adopter une approche globale pour réduire la latence de leurs flux.

Tout d’abord, vous devez vous assurer que vous disposez d’une connexion Internet rapide. connexion internet rapide. Comme nous l’avons mentionné, il est important de disposer d’une vitesse Internet constante correspondant au double de la bande passante que vous prévoyez d’utiliser dans votre flux. Il est également important de s’en tenir autant que possible aux câbles Ethernet. N’optez pas pour le WiFi ou les données, sauf en cas d’absolue nécessité.

Lorsque vous vous efforcez de réduire votre temps de latence, veillez à ne pas nuire à la qualité de votre flux. Bien sûr, il peut y avoir un léger compromis entre la qualité et la latence, mais assurez-vous que les configurations de votre encodeur produiront toujours une image vidéo nette.

Comment réduire la latence au niveau de l’encodeur ?

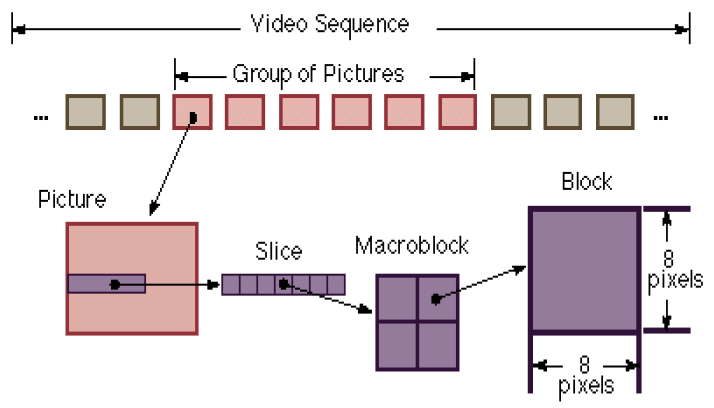

Comment réduire la latence au niveau de l’encodeur ? niveau de l’encodeur? La vidéo est comprimée à l’aide de techniques basées sur l’image ou de techniques de sous-trame, généralement des “tranches”. Un flux vidéo est constitué d’images individuelles. Un cadre est une image entière. Voir le diagramme 1.

La trame A est composée de plusieurs tranches. Si vous pouvez encoder par tranche, vous pouvez réduire la latence de l’encodeur puisque vous n’avez pas à attendre la trame entière avant de transmettre l’information.

Ces encodeurs ont des temps de latence inférieurs à une image, certains n’atteignant que 10 à 30 millisecondes. Un codeur basé sur des images a généralement une latence d’environ 100 à 200 millisecondes.

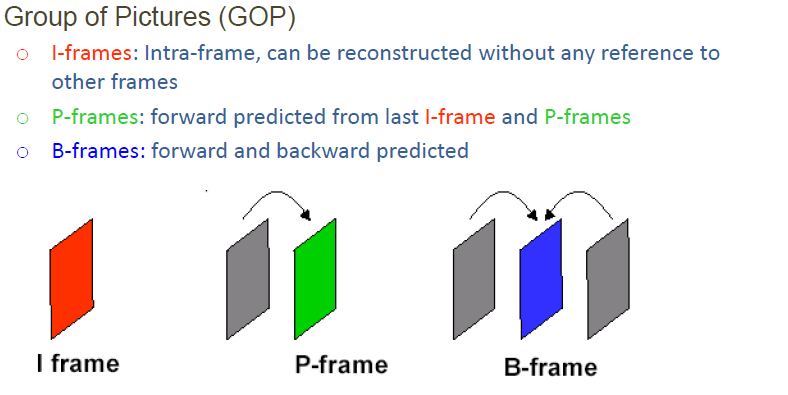

Il est également possible de réduire la latence en supprimant les trames bidirectionnelles. Les images B doivent attendre une prochaine image pour compresser la vidéo. Cela augmente l’efficacité du codeur, mais aussi la latence.

Si vous supprimez les trames B, vous devez augmenter le débit binaire pour obtenir le même niveau de qualité vidéo, un prix que beaucoup sont prêts à payer pour réduire la latence.

Paramètres de diffusion en continu

Le débit et la bande passante sont deux composantes techniques de la diffusion en direct qui vont de pair avec la latence. Nous avons brièvement abordé chacun de ces indicateurs tout au long de ce billet, mais pour comprendre leur relation à un niveau plus technique, il est préférable de les comparer côte à côte.

Pour rappel, la bande passante est la mesure des données transférées dans votre flux vidéo, et le débit est la quantité de données transférées dans un laps de temps donné.

Lorsque vous examinez la relation entre latence, le débit et la bande passante vous pouvez imaginer des voitures traversant un tunnel. Le nombre de voitures pouvant passer en même temps est limité, ce qui entraîne des embouteillages.

Dans ce scénario, la largeur de bande est la largeur du tunnel, le débit est le nombre de voitures qui le traversent et la latence est le temps que mettent les voitures à le traverser. Pour réduire la latence, votre installation de diffusion en continu doit avoir une puissance adaptée à la taille du fichier que vous transmettez.

Latence vidéo sur Dacast

Comme nous l’avons vu, la latence des vidéos a beaucoup à voir avec l’hébergeur de streaming vidéo que vous utilisez. Les flux sur Dacast ont un latence de seulement 12 à 15 secondes ce qui est considéré comme une diffusion en continu à faible latence.

Ce niveau de latence est obtenu grâce à la combinaison de la diffusion HLS et de l’ingestion RTMP. Les utilisateurs de Dacast peuvent également utiliser l’ingestion HLS, mais la latence n’est pas aussi faible avec cette approche.

Dacast prend également en charge la diffusion en continu de conférences Web grâce à l’intégration de Zoom, pour une diffusion à latence encore plus faible.

Rendez-vous dans notre base de connaissances pour consulter notre guide dédié à la mise en place d’un canal de diffusion en continu à faible latence. la mise en place d’un canal de streaming à faible latence sur Dacast.

FAQ

1. Quelle est une bonne latence pour la vidéo ?

Une bonne latence pour la diffusion vidéo en continu est d’environ six secondes. Tout ce qui est inférieur à cette valeur est encore mieux et tend à donner aux téléspectateurs une expérience de visualisation presque en temps réel. Cela dit, le temps de latence standard pour la diffusion de vidéos varie entre 5 et 18 secondes. Avec Dacast, vous pouvez facilement atteindre une latence de 12 à 15 secondes.

2. Comment réduire la latence vidéo ?

Vous pouvez réduire la latence de vos vidéos de deux manières principales. Tout d’abord, mettez de l’ordre dans votre vitesse d’accès à l’internet. Utilisez une connexion internet rapide et fiable pour vous assurer que votre flux est téléchargé rapidement et dans la meilleure qualité possible.

En outre, vous pouvez réduire la latence au niveau de l’encodeur en accélérant le processus d’encodage. À ce stade, vous pouvez choisir de conserver votre qualité ou d’en sacrifier une partie pour une meilleure latence – c’est à vous de choisir.

3. Quelles sont les causes de la latence vidéo ?

La latence est le temps qui s’écoule entre le moment où un fichier vidéo passe de son point d’origine à l’appareil du spectateur. La vidéo passe par un encodeur, puis un relais vers le CDN, puis un relais du CDN vers l’appareil du spectateur, et enfin le décodage. Ce processus prend beaucoup de temps et entraîne une latence dans votre flux.

4. Quelle est la latence vidéo perceptible ?

La latence vidéo n’est remarquée que lorsqu’elle dépasse 100 ms. À ce stade, vous pouvez commencer à remarquer un décalage entre l’événement réel et la diffusion en direct. Cela dit, si vous êtes performant, vous pouvez commencer à remarquer la latence dès 10 ms.

5. Quelle est la latence d’une vidéo ?

En termes simples, la latence vidéo est le temps que met la vidéo à voyager de sa source (la caméra) à sa destination (l’appareil du spectateur). Ce temps est généralement représenté en millisecondes et peut aller jusqu’à 18 secondes pour une diffusion normale. Une latence plus faible est souhaitable pour une expérience de visualisation en temps quasi réel.

Réflexions finales

En tant que diffuseur, il est important d’avoir une bonne compréhension de la latence. Savoir comment fonctionne la latence et comment vous pouvez contrôler la latence de votre installation de diffusion en continu vous donnera plus de pouvoir sur le résultat de votre diffusion.

Vous recherchez une plateforme de diffusion en direct à faible latence pour le streaming professionnel ? Dacast pourrait être l’option qui vous convient. Notre plateforme vidéo en ligne comprend une variété de fonctionnalités qui permettent la diffusion en continu au niveau professionnel, notamment un lecteur vidéo HTML5 pour tous les appareils, des analyses avancées, une API vidéo, une plateforme de diffusion en marque blanche, l’ ingestion et la lecture RTMP, ainsi qu’une assistance à la clientèle 24 heures sur 24 et 7 jours sur 7.

Vous pouvez essayer Dacast sans risque pendant 14 jours grâce à notre essai gratuit. Inscrivez-vous dès aujourd’hui pour commencer la diffusion en continu. Aucune carte de crédit ni aucun contrat contraignant n’est requis.

Pour obtenir régulièrement des conseils sur la diffusion en direct et des offres exclusives, vous pouvez rejoindre le groupe LinkedIn de Dacast sur LinkedIn.

Veuillez noter que cet article a été rédigé à l’origine par Mike Galli, PDG de Niagara Video. Il a été révisé en 2021 par Emily Krings afin d’y inclure les informations les plus récentes. Emily est une rédactrice de contenu stratégique et une conteuse. Elle se spécialise dans l’aide aux entreprises pour créer un contenu de blog qui touche leur public.